データ分析の目的、考え方、フレームワークと統計

概要

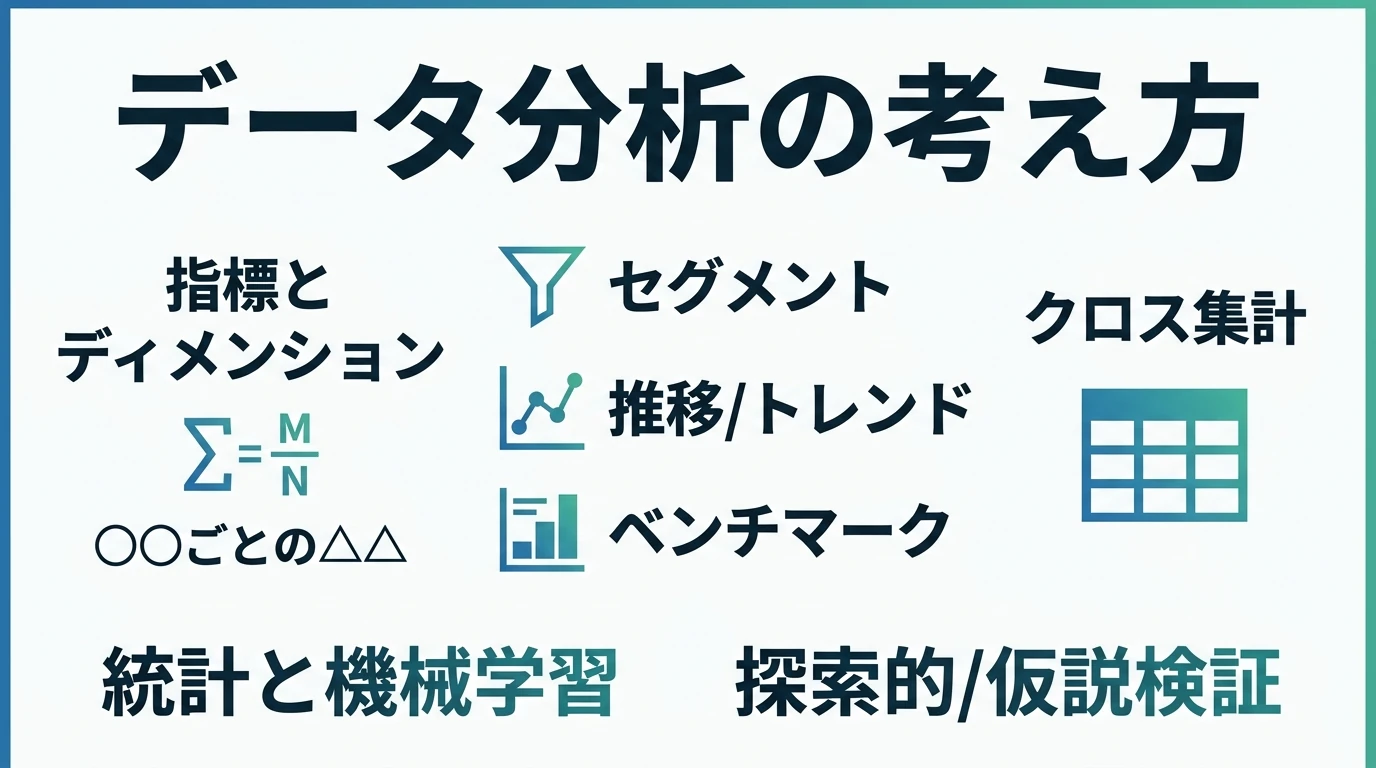

データ分析の考え方

データに基づいて意思決定をすることは、もはやビジネスの前提となった。 AIがデータ分析のワークフローを大きく変えつつある今だからこそ、その土台となる「考え方」を正しく理解しておくことが重要である。

データ分析がビジネスの課題を何でも解決してくれるのだろうか?

データ分析には役割と守備範囲、正しい手法というものが決まっている。 間違った使い方をすると間違ったインサイトを導き出すことになる。

何でもデータ分析が解決してくれるわけではなく、データ分析の守備範囲とそうでない部分は峻別しなければならない。 データ分析を正しく理解して実務に役立てていくために実務上、最低限抑えておけばいいところをまとめていく。

- そもそもデータ分析とは何なのかを整理し

- データ分析と向き合う正しい姿勢と最低限の知識を説明する

データ分析の目的

データ分析には目的がある。主に以下の4種類に分けられる。

- 予測:売上予測、クリック率予測

- 意思決定:どの変数がどれだけのインパクトで効いているのか →アクションの方向性・タイミングを見出す、配信アルゴリズムを決める

- レコメンド:どんな商品をレコメンドするのがいいか

- 分類:セグメントを作る、何と何を同じものとして扱えばいいか

目的に応じて手法が変わってくる。いま直面しているイシューはどれに当てはまるだろうか。

いずれにせよ「だから●●」というアウトプットがある、示唆を得ることが重要になる。

分析とは?

分けていくこと

分析とはその字の通り「分けていくこと」である。

- 全体の「コンバージョン率」の大小を見る(指標)

- 「流入元」ごとの「コンバージョン率」を見る(切り口=ディメンション)

指標とディメンション

「流入元」ごとの「コンバージョン数」

最初はざっくりと単一の数値そのものを見る。流入数、売上、利益など。これが指標となる。

次に商品、営業ブロック毎といったように数値を見る切り口が加わる。これがディメンションとなる。

○○ごとの△△

これがデータを見る基本の考え方となるので、いま見ている指標とディメンションが何なのかを常に意識することが重要である。 「分ける」キーになるものである。

ディメンションごとの指標を見るのはクロス集計、要するに縦横。 クロス集計の考え方と方法は後で説明する。

GoogleアナリティクスでもAdobe Analyticsでも、 BIツールや初歩的なデータ分析ツールは共通してこの考え方に基づいてデータを操作する。 高度な統計解析手法も基本的に指標とディメンションを複雑に組み合わせた(モデル化した)ものである。

分析ツールによっては

- 指標はmetrics, measure(メジャー)などの単語で置き換えられる

- ディメンションはそのままdimensionとして使われることが多い

ただ指標とディメンションを眺めているだけでは分析ではない。 それは数字を見ているだけで、何も言えない、知見にならない。

知見を導き出すための分析的視点としてここから深掘りする際に3つの方向性がある。 それがセグメント、推移、ベンチマークである。

比較して違いを見つけること

ケース1

| ページ | 流入数 | CVR |

|---|---|---|

| 記事A | 500 | 2% |

| 記事B | 400 | 2% |

| 記事C | 300 | 2% |

ケース2

| ページ | 流入数 | CVR |

|---|---|---|

| 記事A | 500 | 2% |

| 記事B | 400 | 1% |

| 記事C | 300 | 5% |

どちらのほうが意味を見いだせるか、知見を導き出すポテンシャルがあるか?

ケース1では流入数に違いはあるものの、CVRについては何の情報も持たない。 ケース2で初めて記事のパフォーマンスを議論できる。

比較の視点

- 「ユーザ種別」が「新規ユーザ」の場合の「流入元」ごとの「コンバージョン率」を見る(セグメント)

- 「コンバージョン率」の推移を見る(トレンド)

- (前年と比較して)「コンバージョン率」がいいか悪いかを判断する(ベンチマーク)

視点が細分化されていく、対象を分けて見ていくのである。

セグメントとは絞り込むこと。新規ユーザとリピータとで行動の傾向が大きく異なる場合、それらをごちゃ混ぜにして数字を見ても意味のある示唆は出にくい。

トレンドは時系列での推移を見ることである。増加しているのか、減少しているのか、周期性があるのか、それによって得られる示唆は異なる。

ベンチマークは比較すること。何かと比較しないことにはいいのか悪いのか判断しにくい。世の中の標準であったり、前年実績であったり、あるいはサイト平均と比較するなどというのも典型的なベンチマークの考え方である。

結局比較対象がないと議論が進まない。分析とは比較、すなわち比べることなのである。

この3つの視点がデータを見る基本になる。

セグメント

「ユーザ種別」が「新規ユーザ」の場合の「流入元」ごとの「コンバージョン数」を見る

上記のセグメントはディメンションの組み合わせによるものだが、指標によるセグメントもある。 「直近1年間の購入金額が大きい顧客」の「平均購入回数」などである。

セグメントは

分析対象(顧客、配信面、商品、…)の一部を切り出して見ていくこと

である。

目的はイシューを明確化してデータを見ること。 「このセグメントは○○だ」と言うことができて、そしてその「○○」が実務上意味のあるものでなければならない。

全データを見てもさまざまなものが混ざっているために特徴が分からない、何も導き出せないのが普通である。 意味のあるセグメンテーションというのは、セグメントごとの特徴を把握できるものである。

そのためにはセグメント内の同質性が担保されており、さらにセグメント間にきちんと異質性があることが重要。

たとえばwebサイトのトラフィックで、 自然検索流入と直接流入(ノーリファラー)とでサイト内行動の傾向(直帰率、CVR、滞在時間など)が似通っているのであれば そこで分ける意味はないのである。

やみくもにディメンションを切り出してセグメントを作ればいいというものではない。 切り出す観点は

- 適度な数

- 認識しやすい、イメージできる

- アクションが分かれる

推移

「コンバージョン数」の推移を見る

時系列で見る視点である。マーケティングのデータは日次・月次など時の経過を含むものが多く、この視点で見ることも必要である。

時系列のポイントとして、時系列の変化というのは以下の要素で構成される。

- 傾向(トレンド)

- 周期性(サイクル)

- 季節性など

- それ以外の変動(「全体の変動」-「傾向」-「周期性」)

- ランダムなばらつき

- スパイク

傾向は単調に増加/減少するといった一方向の流れ。 循環は季節変動など周期性があるもので、最終的には元の水準に落ち着く。 マーケティングでは1年を1つのサイクルとして見る、年単位が基本となる。

推移を見る観点というのは

指標の傾向を読み解く、周期性を読み解く、残ったそれ以外の変動(とその原因)を読み解く

ということである。

分析のフレームワークは「セグメント、トレンド、ベンチマーク」という場合があるが、 厳密には「トレンド」は時系列の一部の要素に過ぎないので、ここでは推移と言っておく。

ベンチマーク

(○○と比較して)「コンバージョン率」がいいか悪いかを判断する

他の対象と比較することで結論を導き出すことである。

比較対象がないといいか悪いか言えない。施策が必要なのか議論できない。 「前年と比較する」「競合と比較する」「サイト平均と比較する」なども典型的なベンチマークの考え方。

直近1か月の売上の数値だけ見ても、それがいいのか悪いのかわからない。「何とも言えない」という結論になる。

この3つの視点がデータを見る基本。

クロス集計表

| 料理する | しない | 計 | |

|---|---|---|---|

| 男性 | 50 | 100 | 150 |

| 女性 | 80 | 80 | 160 |

| 計 | 130 | 180 | 310 |

クロス集計表こそがディメンションごとに指標を見る分析の基本となる。 縦横(表頭、表側)それぞれがディメンションで、中に入る値が指標となる。

| ディメンションB=1 | ディメンションB=2 | |

|---|---|---|

| ディメンションA=1 | 指標 | 指標 |

| ディメンションA=2 | 指標 | 指標 |

あるいはこれもクロス集計表である。

| CVした | CVしなかった | |

|---|---|---|

| 自然検索 | 100 | 9,900 |

| リスティング広告 | 80 | 3,920 |

| ソーシャルメディア | 30 | 4,970 |

クロス集計表の考え方は古くはOLAPとして知られ、ExcelのピボットテーブルやBIツールもこの考え方に基づく。

ここではクロス集計表の分析フレームワークを紹介する。

- ドリルダウン

- スライス

- ダイス

ドリルダウン

細かく掘り下げていく(年別→月別→週別)

セッション数

| 自然検索 | 検索連動型広告 | |

|---|---|---|

| 1月 | 10,000 | 8,000 |

| 2月 | 8,000 | 7,000 |

↓

| 自然検索 | 検索連動型広告 | ||

|---|---|---|---|

| 1月 | 第1週 | 2,000 | 2,500 |

| 1月 | 第2週 | 2,500 | 2,000 |

| 1月 | 第3週 | 2,700 | 2,000 |

| 1月 | 第4週 | 2,800 | 1,500 |

| 2月 | 第1週 | 2,000 | 1,500 |

| 2月 | 第2週 | 2,000 | 1,500 |

| 2月 | 第3週 | 2,000 | 2,000 |

| 2月 | 第4週 | 2,000 | 2,000 |

時というオブジェクトを大きな粒度から小さな粒度へとより詳細に見ていく。 他には地域で国→地方→県といった粒度で掘り下げるのもこれに該当する。

スライス

特定の条件を切り出して見る

- キーワード種別がブランドワードのみ

- 特定の広告ネットワークのみ

| 自然検索 | 検索連動型広告 | |

|---|---|---|

| 新規訪問 | 4,000 | 4,500 |

| リピータ | 6,000 | 3,500 |

↓

<フィルタ> キーワード種別=ブランドワードの場合

| 自然検索 | 検索連動型広告 | |

|---|---|---|

| 新規訪問 | 1,000 | 1,000 |

| リピータ | 4,000 | 2,000 |

<フィルタ> キーワード種別=一般ワードの場合

| 自然検索 | 検索連動型広告 | |

|---|---|---|

| 新規訪問 | 3,000 | 3,500 |

| リピータ | 2,000 | 1,500 |

現在見えている表だけでは情報があいまいなとき、特定の条件のみを切り出してみることで何らかの特徴が見えることがある。

ダイス

見る軸を切り替える

- 流入元別←→流入先別

- 男女別←→年齢別

あるECサイトの販売個数

| 消費財 | 食料品 | |

|---|---|---|

| 男性 | 5,000 | 5,000 |

| 女性 | 5,000 | 5,000 |

↓

| 消費財 | 食料品 | |

|---|---|---|

| 10代 | 1,000 | 2,000 |

| 20代 | 1,500 | 2,000 |

| 30代 | 3,000 | 2,000 |

| 40代 | 3,500 | 2,000 |

| 50代 | 1,000 | 2,000 |

縦軸(表側)を性別から年齢別に切り替えている。 変数を入れ替えてみることも重要。

ドリルダウン、スライス、ダイスを駆使して、最終的に「○○のほうが△△だ」という傾向や「○○と××は関係がない」などの結論を見出すのがクロス集計の目的となる。

探索的アプローチと仮説検証アプローチ

データ分析を進めていくアプローチには大きく2つのタイプがある。

- 探索的アプローチ

- とりあえずデータを見てみて、そこから何か知見が得られないか探ってみる

- 仮説検証アプローチ

- 仮説を作り、見るべき変数にあたりを付けて絞り込んで見ていく

- 仮説を作り、それにデータを当てはめて仮説の妥当性を検証する。フィードバックする。

昔から言われている「データマイニング」は探索的アプローチ。すべてのデータを見て金脈(っぽいもの)がないか探す考え方である。

データマイニングの手法はデータが複雑になった時、変数の数が多くなった時に、ある程度うまいことデータを見るのに威力を発揮する。

しかしそれでも実際には変数の数が増えると、どこからデータを見ればいいか?手の付けようがなくなる。何らかの関係性があるように見えても、単なる偶然かもしれない。本当に理論を持ってその関係性を正しいと言えるのだろうか?

どちらの変数がニワトリでどちらの変数がタマゴ?データだけでは因果関係もわからない。

実際の分析では探索的アプローチには限界がある。 ビジネス知見を加え、見るべきポイントをある程度絞る必要がある。

基本的には仮説検証アプローチ。理論に基づいて仮説を作ることが重要。

統計の位置づけ

「データ分析」という言葉とともに「統計(解析)」という言葉も出てくることが多い。 この統計はデータ分析のどこに位置づけられるのか?これまで説明してきたデータとの向き合い方とどんな関係があるのか?

統計解析というのは数あるデータ分析の方法の中の一つの大きな括りであり、データを正しく効率的に扱う方法である。

上記の手順も変数の数が増えてくると一つずつ進めるのが面倒になる。それを効率的に行うのが統計のアプローチになる。

また、セグメント間で指標の数値に違いが見られたが、それによってそのセグメント間で違いがあると言っていいものなのか? 偶然の違いではないのか?今後も違いが発生するといえるのだろうか?

そういった「違い」の基準も提供してくれるのが統計の手法である。

統計の手法は手間もコストもかかるが、それなりに価値はある。 ただ忘れてはならないのはコストがかかるという点。

ツールや人だけでなく、正しい統計の手法に則ったテストを実行するにもコストがかかる。 コストを許容できないようであれば実施すべきではないし、中途半端にしかコストをかけられないというのであってもやめたほうがいい。

またコストをかけて統計処理をしなくても正解を導き出せるなら不要。 ということで、小さい規模のビジネスでは統計を使うこと自体ビジネス観点で不適であるケースもある。

統計と機械学習

「統計」だけでなく「機械学習」という言葉も出てくることが多い。 統計解析も機械学習もデータ分析の手法の大きなカテゴリのことで、それぞれちょっと異なる。

分析手法には統計的な手法と機械学習的な手法がある

ということである。

- 統計:昔ながらの方法、コンピュータが貧弱だったので少ない計算量で何とか分析を完結できるようにしてきた。

- 記述統計「全データを見る」

- 推測統計「一部のデータから全体を推測する」

- 機械学習:コンピュータに頼った力任せの方法。大量のデータを豊富なコンピュータリソースで処理

統計と機械学習とでは流儀が違う。文化が違う。

統計の世界でしか使われない手法があるし、機械学習の世界でしか使われない手法がある。それらはこのような文化の中で培われてきたもの。

ただし統計の世界で使われている個別手法で機械学習の世界でも使われている手法もある。